Anthropic accuse trois start-ups chinoises spécialisées dans l'IA — DeepSeek, Moonshot et MiniMax — d'avoir mené une campagne à grande échelle pour utiliser Claude afin d'améliorer leurs propres modèles.

Des laboratoires de la RPC ont généré plus de 16 millions d'interactions avec des chatbots via environ 24 000 comptes frauduleux, violant ainsi les conditions d'utilisation et les restrictions régionales.

« Nous avons associé chaque campagne à une entreprise spécifique avec un haut degré de certitude, en nous basant sur les corrélations entre les adresses IP, les métadonnées des requêtes, les caractéristiques de l'infrastructure et les confirmations de nos partenaires du secteur. Ils ont ciblé les capacités les plus uniques de Claude : le raisonnement agentiel, les outils et la programmation », a déclaré Anthropic.

Les entreprises ont utilisé la distillation — l'entraînement d'un réseau neuronal moins puissant sur les conclusions d'un réseau plus puissant.

Il s'agit d'une méthode largement utilisée et légitime. Les principaux laboratoires d'IA simplifient régulièrement leurs propres modèles afin de créer des versions plus compactes et moins coûteuses pour leurs clients.

« Cependant, cela peut aussi être utilisé illégalement : des concurrents améliorent leurs capacités aux dépens des LLM d'autres personnes, pour un coût et un temps réduits par rapport à un développement indépendant », indique le blog Anthropic.

L’entreprise a souligné que la marge de manœuvre pour réagir à un tel « vol » est réduite et que la menace dépasse le cadre d’une seule entreprise ou région. Son élimination exige une action rapide et coordonnée de la part du secteur, des autorités de réglementation et de la communauté mondiale de l’IA.

Pourquoi est-ce dangereux ?

Anthropic a expliqué les risques de cette approche : les modèles distillés illégalement ne conservent pas les mécanismes de protection nécessaires, ce qui crée des problèmes pour la sécurité nationale.

Les entreprises américaines mettent en place des systèmes visant à empêcher l'utilisation de l'intelligence artificielle pour développer des armes biologiques, mener des cyberattaques malveillantes et se livrer à d'autres activités dangereuses. Les modèles créés par distillation illégale ne font l'objet d'aucune restriction similaire.

L'entreprise a ajouté que des laboratoires étrangers peuvent intégrer des capacités non sécurisées dans les systèmes militaires et de renseignement, permettant ainsi aux gouvernements autoritaires d'utiliser une IA avancée pour des cyberattaques, la désinformation et la surveillance de masse.

Moyens de contrer

Des experts en anthropologie soutiennent les restrictions à l'exportation afin de préserver le leadership américain en intelligence artificielle. Ils affirment que les attaques par distillation compromettent ces mesures en permettant aux laboratoires étrangers de combler leur retard technologique.

« En l’absence de transparence concernant ces attaques, les progrès rapides des laboratoires chinois sont interprétés à tort comme une preuve de l’inefficacité des restrictions à l’exportation. En réalité, leurs succès reposent en grande partie sur la neutralisation des capacités des modèles américains, et le déploiement à grande échelle d’une telle approche nécessite l’accès à des puces de pointe », indique le blog de l’entreprise.

Anthropic a nommé ses propres contre-mesures :

- amélioration du système de détection du modèle de distillation ;

- échange d'indicateurs techniques avec d'autres laboratoires et fournisseurs de services cloud ;

- renforcement de la vérification des comptes rendus d'enseignement et de recherche ;

- le recours à des contre-mesures visant à réduire l'efficacité de la distillation illégale.

Ce n’est pas la première accusation de ce genre. En janvier 2025, peu après la publication très médiatisée de DeepSeek-R1, l’entreprise a été soupçonnée d’avoir volé des données à OpenAI.

Poursuite des affrontements avec le Pentagone

Le PDG d'Anthropic, Dario Amodei, rencontrera le secrétaire à la Défense, Pete Hegseth, au Pentagone pour discuter des façons dont les modèles d'IA de l'entreprise peuvent être utilisés par l'armée.

Des désaccords sont récemment apparus entre les parties : Anthropic s’oppose à l’utilisation de l’intelligence artificielle pour la surveillance de masse des citoyens américains et la création d’armes autonomes. Le ministère de la Défense a clairement indiqué son intention d’utiliser le LLM « dans tous les scénarios légaux », sans restriction.

La situation est devenue telle que le Pentagone a annoncé la possible résiliation du contrat avec Anthropic.

scanner de vulnérabilités IA

Les actions des principales sociétés cotées en bourse spécialisées dans la cybersécurité ont chuté après le lancement par Anthropic de Claude Code Security, un scanner de vulnérabilités de code basé sur l'IA.

Le site web de l'entreprise indique que le nouveau service « analyse l'intégralité du code source à la recherche de vulnérabilités, vérifie chaque résultat afin de minimiser les faux positifs et propose des correctifs ».

Claude mène son analyse « comme un chercheur en sécurité expérimenté » : il comprend le contexte, surveille les flux de données et identifie les vulnérabilités.

Selon VentureBeat, Claude Opus 4.6 a révélé plus de 500 vulnérabilités critiques qui avaient persisté pendant des décennies, malgré l'examen minutieux d'experts.

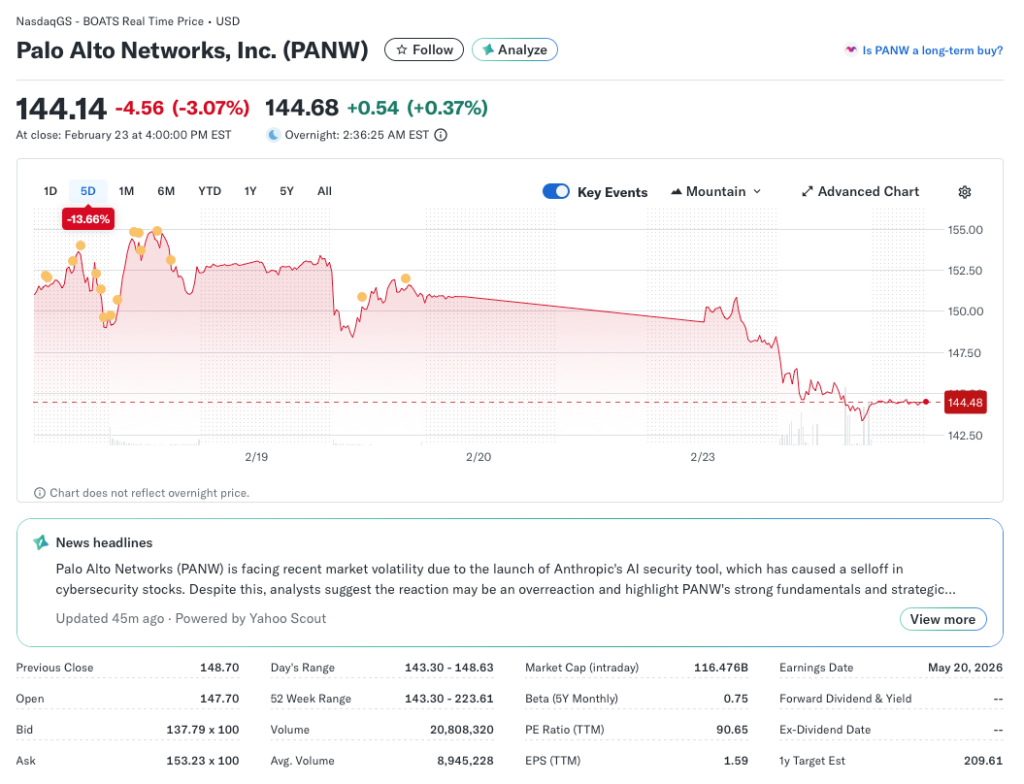

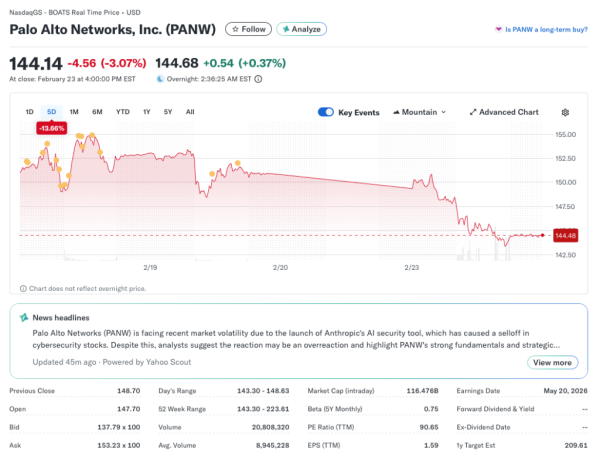

Les cinq plus grandes sociétés américaines de sécurité informatique cotées en bourse, classées par capitalisation boursière, ont enregistré des baisses de cours à deux chiffres au cours des cinq derniers jours, dans un contexte d'émergence d'un concurrent basé sur l'IA :

- Palo Alto Networks — -14 % ;

- CrowdStrike — -18 % ;

- Fortinet — -12 % ;

- Cloudflare — -18 % ;

- Zscaler — -19 %.

Graphique du cours de l'action Palo Alto Networks. Source : Yahoo Finance.

Les analystes de Wedbush ont expliqué cette chute des cours par les inquiétudes liées au « marché fantôme de l'IA » . Ils estiment que la réaction du marché est mal fondée et que Palo Alto, CrowdStrike et Zscale feront leurs preuves en 2026.

Rappelons qu'en février, OpenAI, en collaboration avec Paradigm, a introduit EVMbench, un outil de référence pour évaluer la capacité des agents d'IA à détecter, corriger et exploiter les vulnérabilités des contrats intelligents.