Nvidia a lancé Nemotron 3 Super, un modèle à 120 milliards de paramètres pour les agents d'IA autonomes, et a révélé son intention d'investir 26 milliards de dollars dans le développement de l'IA open source sur un horizon de cinq ans.

Les modèles OpenAI sont des modèles dont les poids sont accessibles publiquement : tout développeur peut télécharger un tel modèle, l’exécuter sur son propre matériel et l’adapter à ses besoins, sans dépendre d’un service tiers. Cela les distingue fondamentalement des solutions propriétaires comme GPT-4 ou Claude, accessibles uniquement via une API.

Cette étape soulève un problème d'ingénierie spécifique. Les systèmes multi-agents génèrent beaucoup plus de jetons qu'une conversation classique : chaque appel d'outil, chaque étape de raisonnement et chaque élément de contexte sont renvoyés de zéro. Les coûts explosent, les modèles commencent à dériver et les agents perdent progressivement en précision.

Architecture : trois composants en un

Grâce à son architecture de type « Mixture d’experts » (MoE), le modèle n’active simultanément que 12 milliards de ses 120 milliards de paramètres. Une fenêtre de contexte d’un million de jetons permet aux agents de mémoriser l’intégralité du code source (environ 750 000 mots) sans perte de cohérence.

Nvidia a combiné trois composants en une seule architecture : des couches Mamba-2 pour un traitement efficace des longues séquences, des couches Transformer pour une extraction précise des informations et un moteur Latent MoE qui active quatre fois plus de spécialistes pour le même coût de calcul.

Le modèle a été entraîné dès le départ au format NVFP4 4 bits. L'approche classique est différente : un entraînement initial en haute précision, suivi d'une compression, souvent au détriment de la qualité du raisonnement. Nemotron 3 Super apprend d'emblée à fonctionner dans des conditions de faible précision, au lieu de s'y adapter a posteriori.

Productivité et ouverture

Comparé à son prédécesseur, ce modèle offre un débit plus de cinq fois supérieur. Face à ses concurrents, Nemotron 3 Super est 2,2 fois plus rapide que GPT-OSS 120B d'OpenAI et 7,5 fois plus rapide que Qwen3.5-122B d'Alibaba. Les poids sont publiés sur Hugging Face et la méthodologie d'entraînement est entièrement open source. Perplexity, Palantir, Cadence et Siemens intègrent déjà ce modèle à leurs processus.

26 milliards de dollars et la géopolitique de l'IA ouverte

D'après ses états financiers de 2025, Nvidia investira 26 milliards de dollars dans le développement de modèles open source sur cinq ans. La raison est simple : les puces Nvidia demeurent l'infrastructure de référence pour l'entraînement des modèles, et les solutions optimisées pour leur architecture permettent de fidéliser les clients au sein de son écosystème.

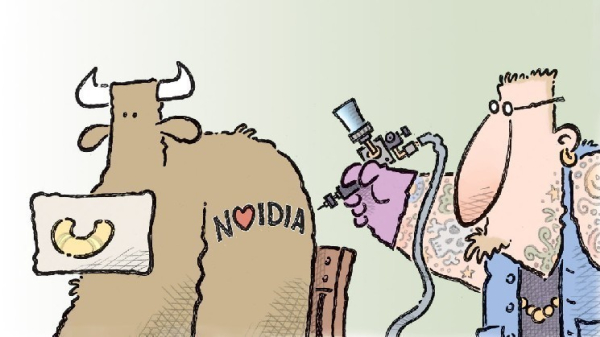

La part des modèles open source chinois dans l'utilisation mondiale est passée de 1,2 % fin 2024 à environ 30 % fin 2025. Qwen d'Alibaba a détrôné Llama de Meta comme modèle auto-hébergé le plus utilisé. Tandis qu'OpenAI, Anthropic et Google conservent leurs meilleurs modèles derrière des API fermées, les laboratoires chinois développent activement l'écosystème open source. Le lancement du Nemotron 3 Super et un investissement de 26 milliards de dollars constituent la réponse de Nvidia à ce défi.

L'avis de l'IA

Nvidia subventionne de fait les concurrents de ses principaux clients : OpenAI, Anthropic et Google. Chaque développeur qui reçoit un modèle performant gratuit et le déploie sur du matériel tiers devient un acheteur potentiel de puces Nvidia. L’entreprise ne développe pas une activité secondaire ; elle met en place un système de distribution pour son activité principale.