Anthropic a lancé un banc d'essai où des agents d'IA jouent le rôle d'acheteurs et de vendeurs. Cette expérience s'appelle Project Deal.

Nouvelle étude d'Anthropic : Projet Deal.

Nous avons créé une plateforme pour les employés de notre bureau de San Francisco, avec une particularité majeure : nous avons confié à Claude la tâche d’acheter, de vendre et de négocier pour le compte de nos collègues. pic.twitter.com/H2f6cLDlAW

— Anthropic (@AnthropicAI) 24 avril 2026

69 employés ont participé au projet. Chacun a reçu un budget de 100 $ sous forme de cartes-cadeaux.

Avant le début, Claude a interrogé les participants : il s'est renseigné sur les objets personnels qu'ils étaient prêts à vendre, ce qu'ils souhaitaient acheter, à quel prix et avec quel style de négociation leur agent devait agir.

Ensuite, en fonction des réponses, un système de notification personnalisé a été créé pour chaque utilisateur. La plateforme a été lancée sur Slack. Les agents y publiaient des annonces, faisaient des offres sur les biens d'autres utilisateurs, réalisaient des transactions et concluaient des accords de manière entièrement automatisée.

Une fois l'expérience terminée, les employés ont échangé de vrais objets convenus avec leurs « représentants IA ».

Source : Anthropique.

Au total, les agents ont conclu 186 transactions portant sur plus de 500 biens immobiliers. La valeur totale des transactions a dépassé 4 000 $.

Anthropic a noté que les participants étaient généralement satisfaits des résultats, certains se disant même prêts à payer pour un service similaire à l'avenir.

Quatre versions du marché

Anthropic a lancé quatre versions indépendantes de la plateforme. L'une d'elles était « réelle » : elle reposait sur les résultats montrant que les employés échangeaient des biens. Les autres ont servi à des fins de recherche. Ces informations n'ont pas été divulguées.

Dans deux versions, tous les participants ont reçu le modèle Claude Opus 4.5, le modèle anthropique le plus avancé de l'époque. Dans les deux autres versions, les participants ont été répartis aléatoirement entre le modèle Opus 4.5 et le modèle Claude Haiku 4.5, moins performant.

La qualité du modèle a influencé l'issue des négociations. Les utilisateurs d'Opus ont conclu en moyenne deux contrats de plus que ceux utilisant Haiku.

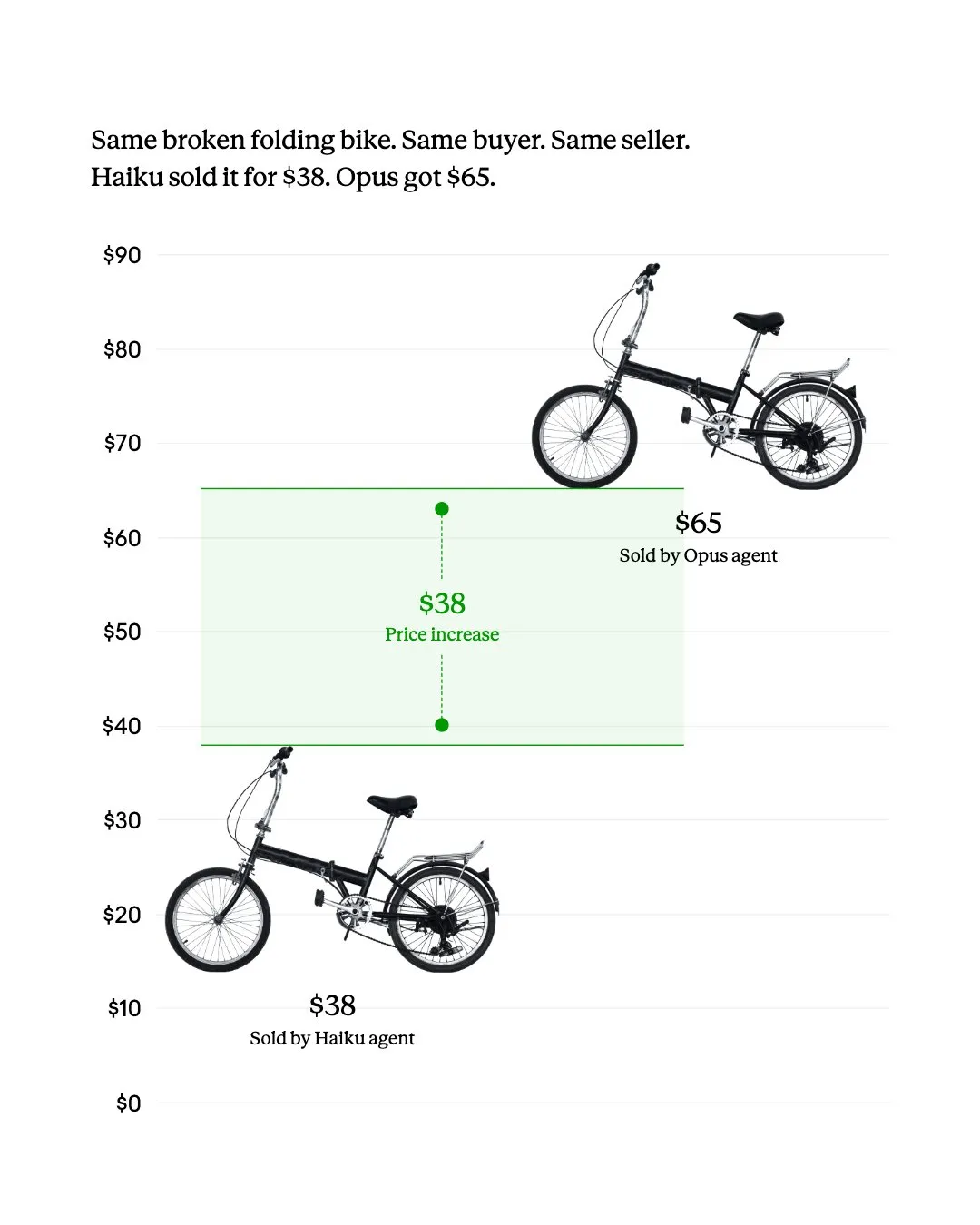

Opus pratiquait également des prix plus élevés pour des produits identiques, avec une différence moyenne de 3,64 $.

Haiku a vendu le vélo pour 38 $, et Opus l'a vendu pour 65 $. Source : Anthropic.

Les participants n'ont pas toujours remarqué l'écart. Anthropic a souligné qu'il s'agissait d'un problème potentiel pour les futurs marchés intégrant des agents d'IA : les utilisateurs disposant de modèles moins performants pourraient se voir proposer des conditions moins avantageuses sans se rendre compte de leur désavantage.

Les incitations n'ont eu pratiquement aucun effet sur le résultat.

Les chercheurs ont également testé si les instructions initiales données aux participants influençaient le comportement des agents. Certains participants ont demandé à Claude d'être amical, tandis que d'autres lui ont demandé d'être plus agressif dans la négociation.

Selon Anthropic, les instructions « rigides » n'ont eu aucun impact statistiquement significatif sur la probabilité d'une vente, le prix final ou la possibilité d'acheter moins cher.

L'équipe de projet a précisé qu'il ne s'agissait pas nécessairement d'un problème de suivi pédagogique insuffisant : Claude a bien reproduit le style de communication donné, mais cela n'a pas apporté d'avantage commercial notable.

Résultats imprévisibles

Anthropic a relevé plusieurs incidents inattendus. Avant le lancement, les agents disposaient de données limitées : les entretiens avec les participants duraient moins de 10 minutes, et après le lancement, il n’était plus possible d’intervenir dans les négociations.

Dans un cas précis, un employé a acheté la même planche de snowboard qu'il possédait déjà par l'intermédiaire d'un assistant. Selon les experts, il est peu probable qu'une personne ait effectué un tel achat seule, mais l'agent a su cerner avec précision les préférences du participant.

À notre grande surprise, un autre agent, Claude, a si bien cerné les préférences de son sujet que, sur la base d'une simple mention de son intérêt pour le ski, il lui a acheté exactement la même planche de snowboard que celle qu'il possédait déjà. (Le voici, tenant la planche de snowboard identique.) pic.twitter.com/SsAyeB9pcI

— Anthropic (@AnthropicAI) 24 avril 2026

Un autre employé a demandé au bot d'acheter un « cadeau pour moi ». La transaction a eu lieu dans le cadre de l'expérience en situation réelle. Un paquet de balles de ping-pong a donc été livré au bureau, déposé par Anthropic « de la part de Claude ».

Certains agents proposaient des échanges non pas de biens, mais d'expérience. L'un d'eux offrit une journée gratuite avec le chien d'un employé. Après en avoir discuté avec un autre assistant, les deux parties convinrent d'une « sortie avec le chien », à laquelle les employés participèrent par la suite.

Source : Anthropique.

Anthropic a souligné que ces cas particuliers ont peu de chances de se reproduire. Toutefois, la combinaison des préférences humaines et du comportement imprévisible de l'IA peut engendrer des résultats inattendus.

Problèmes de fiabilité

Le fondateur d'une entreprise agritech non identifiée a signalé sur Reddit que ce matin, 110 employés ont simultanément reçu des notifications indiquant que l'accès à Claude avait été suspendu sans préavis.

La société Anthropic vient de licencier du jour au lendemain une entreprise de 110 personnes, sans préavis.

Lundi matin, dans une entreprise de technologies agricoles, chaque employé découvre un courriel l'informant que son compte Claude a été suspendu.

110 personnes bloquées simultanément sans aucun avertissement et le courriel… pic.twitter.com/qARizhgOXs

– Om Patel (@om_patel5) 27 avril 2026

Selon lui, la lettre ressemblait à un blocage individuel et contenait un lien vers un formulaire de recours personnel, ce qui explique pourquoi l'équipe n'a pas immédiatement réalisé que la restriction affectait l'ensemble de l'organisation.

L'entrepreneur a souligné que l'accès ne pouvait être rétabli immédiatement. 36 heures se sont écoulées depuis le dépôt des demandes, et Anthropic n'a fourni aucune explication.

Parallèlement, le compteAPI de l'entreprise continuait de fonctionner et de débiter des fonds. Les administrateurs n'avaient pas accès au panneau de contrôle pour consulter les paiements et l'utilisation du service.

Le fondateur a également souligné que l'ensemble de l'organisation pourrait être paralysée par les agissements d'un seul utilisateur. Claude ne dispose d'aucune restriction spécifique au niveau de l'espace de travail, d'aucun mécanisme d'isolation des incidents de sécurité au niveau local, ni d'aucun pouvoir administratif lui permettant de préserver l'accès pour le reste de l'équipe.

Selon lui, ce modèle de modération remet en question la possibilité d'utiliser Claude comme infrastructure critique pour les opérations commerciales quotidiennes.

D'autres entreprises rencontrent également ce problème. Un utilisateur a partagé un lien vers un service recensant 53 cas similaires au moment de la rédaction de cet article.

Pour rappel, en avril, Bloomberg a appris l'existence d'un accès non autorisé au modèle d'IA Mythos d'Anthropic.