Google a présenté Gemma 4, une nouvelle famille de modèles d'IA ouverts pour le raisonnement avancé et les flux de travail basés sur des agents.

Nous venons de publier Gemma 4 — notre modèle open-source le plus intelligent à ce jour.

S'appuyant sur la même base de recherche de classe mondiale que Gemini 3, Gemma 4 apporte une intelligence révolutionnaire directement à votre matériel pour un raisonnement avancé et des flux de travail basés sur des agents.

Sortie sous licence commerciale… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) 2 avril 2026

« Gemma 4 est notre modèle ouvert le plus intelligent à ce jour. Il offre un niveau d'intelligence sans précédent par paramètre », indique le communiqué.

Depuis le lancement de la première génération, Gemma a été téléchargée plus de 400 millions de fois par les développeurs, donnant naissance à plus de 100 000 variantes de modèles au sein de l’écosystème Gemmaverse. La dernière version repose sur la même recherche et la même technologie que le chatbot Gemini 3.

Différentes tailles

La famille de réseaux neuronaux Gemma 4 comprend quatre versions : Effective 2B (E2B), Effective 4B (E4B), 26B Mixture of Experts (MoE) et 31B Dense.

Les solutions compactes E2B et E4B, dotées respectivement de 2,3 et 4,5 milliards de paramètres actifs, privilégient la multimodalité, la faible latence et une intégration transparente. Elles peuvent être utilisées sur un smartphone ou un ordinateur portable classique.

Les modèles 26B MoE et 31B (26 et 31 milliards de paramètres respectivement) nécessitent un accélérateur graphique Nvidia H100 doté de 80 Go de mémoire. Ces modèles sont optimisés pour les chercheurs et les développeurs.

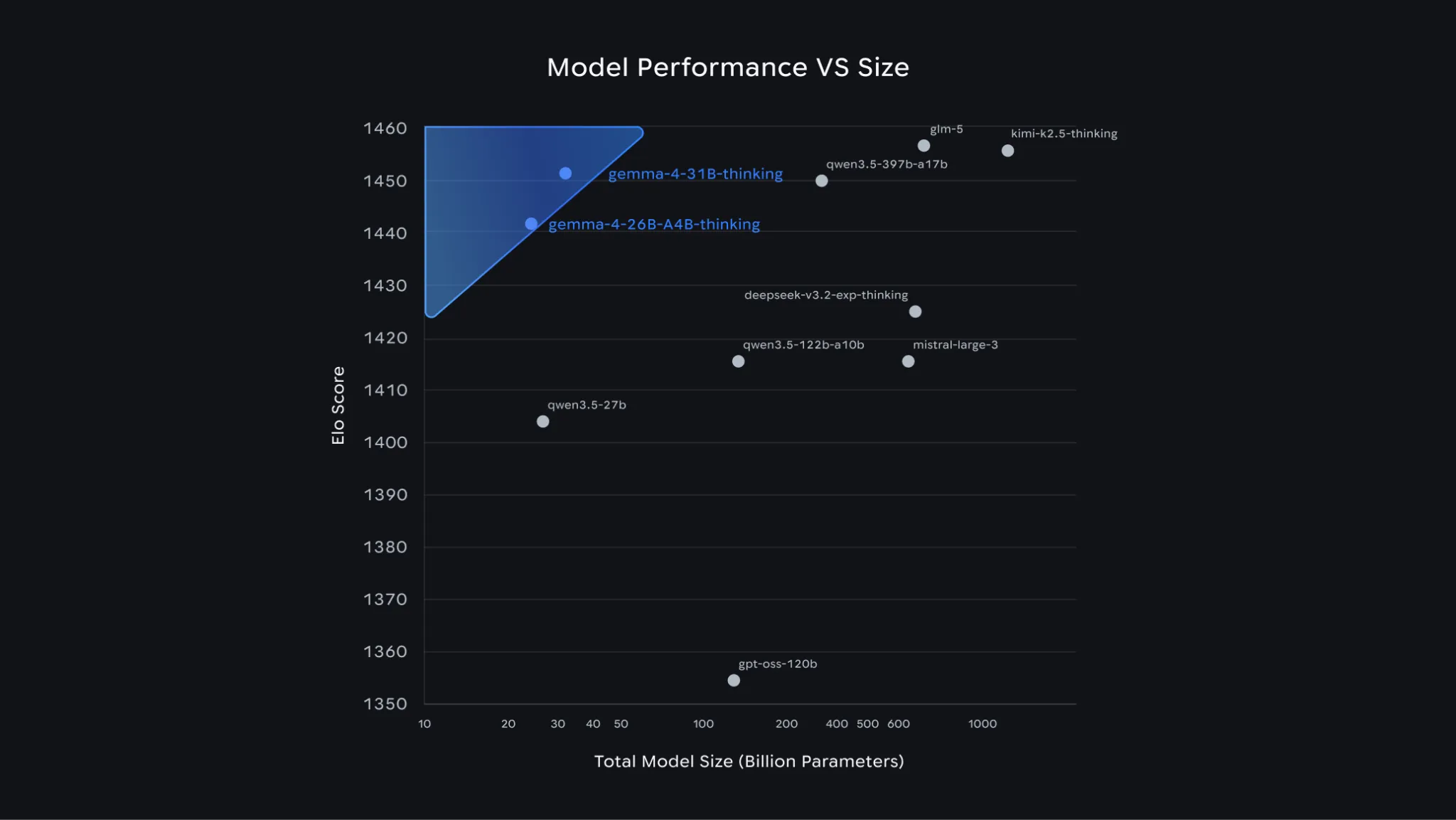

Les versions précédentes affichent d'excellents résultats aux tests de performance. Dans le classement mondial des modèles de texte open source, le modèle phare d'Arena AI, le 31B, occupe la troisième place, et le 26B, la sixième. Selon ses développeurs, cette nouvelle gamme surpasse les modèles concurrents, pourtant 20 fois plus volumineux.

Source : Google.

Caractéristiques principales

L'un des principaux atouts de Gemma 4 réside dans ses capacités de raisonnement avancées. Les modèles peuvent élaborer des logiques complexes et planifier des tâches en plusieurs étapes. Ils affichent des progrès significatifs dans les tests de performance mathématique et suivent les instructions avec précision.

Parmi les autres caractéristiques :

- Les flux de travail des agents — la prise en charge intégrée des appels de fonction, de la sortie JSON structurée et des instructions système vous permet de créer des assistants autonomes qui interagissent avec les outils etles API ;

- génération de code — Gemma 4 prend en charge l'écriture de code de haute qualité en mode hors ligne, transformant le poste de travail en un assistant IA local ;

- Vision et audio — tous les modèles traitent des vidéos et des images à résolution variable, reconnaissent le texte et analysent les diagrammes. E2B et E4B prennent également en charge la reconnaissance et la compréhension de la parole ;

- Fenêtre de contexte étendue : les versions compactes prennent en charge 128 000 jetons, et les versions plus grandes jusqu’à 256 000. Cela suffit pour traiter des référentiels entiers ou des documents volumineux en une seule requête ;

- multilinguisme — cette famille modèle peut travailler avec plus de 140 langues.

Gemma 4 est désormais disponible dans Google AI Studio et Google AI Edge Gallery. Son intégration est également prise en charge par des outils et frameworks tiers populaires, tels que Hugging Face, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM et LM Studio.

Les modèles peuvent être configurés via Google Colab, Vertex AI ou directement sur la carte graphique. Pour le déploiement en production, Google Cloud est disponible, notamment Cloud Run, GKE et Sovereign Cloud.

Rappelons qu'au début du mois d'avril, Google a présenté un nouveau modèle d'IA pour la génération vidéo : Veo 3.1 Lite.