En réaction à l'accord controversé conclu entre OpenAI et le département américain de la Défense, Caitlin Kalinowski a démissionné de son poste de directrice de la division matérielle de l'entreprise.

« Ce n’était pas une décision facile. L’intelligence artificielle joue un rôle important dans la garantie de la sécurité nationale. Mais la surveillance des citoyens américains sans autorisation judiciaire et l’autonomie létale sans consentement humain sont des questions qui méritent davantage d’attention qu’elles n’en reçoivent actuellement », a-t-elle écrit.

Kalinowski a travaillé chez Apple sur le matériel Mac, puis a rejoint Meta, où elle est devenue ingénieure clé au sein de la division Reality Labs. En 2024, elle a intégré OpenAI, où elle dirige la division robotique et matériel grand public.

Dans un communiqué, elle a souligné que cette décision était « une question de principe, et non de personnes », exprimant son « profond respect » pour Sam Altman, PDG d'OpenAI, et pour l'équipe de la start-up.

« À mon avis, ces annonces ont été faites à la hâte, sans définir les limites. C'est avant tout un problème de gestion. Ces affaires sont trop importantes pour se précipiter », a ajouté Kalinowski.

Un représentant d'OpenAI a souligné que l'accord avec le Pentagone « crée une voie de travail pour une utilisation responsable de l'IA à des fins de sécurité nationale, tout en définissant clairement les lignes rouges : pas de surveillance intérieure et pas d'armes autonomes ».

« Nous comprenons que les gens ont des convictions fortes sur ces questions, et nous continuerons à en discuter avec les travailleurs, les gouvernements et la société dans le monde entier », a-t-il ajouté.

L'accord entre OpenAI et le Pentagone a été signé fin février, peu après que les négociations entre Anthropic et le département de la Défense aient abouti à une impasse.

Altman a rapidement admis que l'accord était « hâtif » et « ne fait pas bonne impression » pour l'image de la start-up.

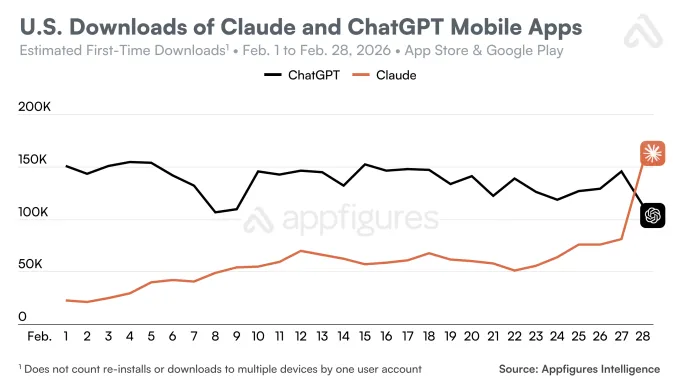

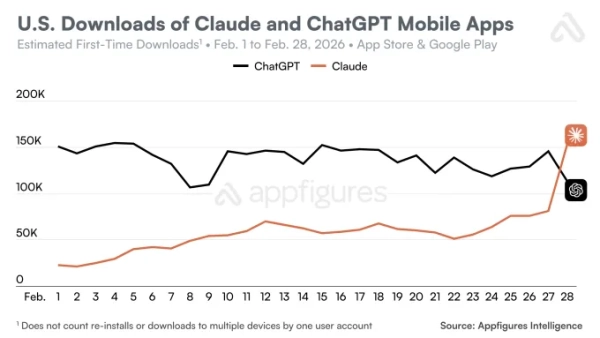

Cette situation a affecté la popularité de ChatGPT et de Claude. Le nombre de désinstallations du premier chatbot a augmenté de 295 %, tandis que le second s'est hissé en tête du classement de l'App Store.

Téléchargements des applications mobiles Claude et ChatGPT aux États-Unis. Source : Appfigures.

Confrontation entre les autorités et les anthropologues

En juillet 2025, le département américain de la Défense a attribué des contrats d'une valeur maximale de 200 millions de dollars à Anthropic, Google, OpenAI et xAI pour développer des solutions d'IA en matière de sécurité.

En janvier 2026, le Wall Street Journal a rapporté que l'accord avec Anthropic risquait d'être rompu. Les désaccords portaient sur la politique éthique stricte de la start-up, qui interdit notamment l'utilisation du modèle Claude pour la surveillance de masse et les opérations létales autonomes.

En février 2026, l'armée américaine a déployé Claude dans une opération visant à capturer le président vénézuélien Nicolas Maduro, à la suite de laquelle le conflit s'est intensifié.

Le PDG de l'entreprise, Dario Amodei, a rencontré le secrétaire à la Défense, Pete Hegseth, pour discuter de la situation. Le ministère a lancé un ultimatum : Anthropic doit accepter les conditions du gouvernement avant le 27 février.

Amodei a déclaré qu'il préférait ne pas coopérer avec le Pentagone plutôt que d'accepter d'utiliser sa technologie qui pourrait « saper, plutôt que protéger, les valeurs démocratiques ».

Fin février, le président américain Donald Trump a ordonné à toutes les agences fédérales d'abandonner complètement l'utilisation des technologies anthropiques dans un délai de six mois.

Il a qualifié la start-up d'entreprise « incontrôlable » dirigée par des personnes qui « n'ont aucune idée de ce qu'est le monde réel ».

Le Pentagone a officiellement désigné Anthropic comme un « risque pour la chaîne d'approvisionnement », ce qui met en péril ses relations commerciales avec d'autres fournisseurs du gouvernement. Microsoft et Google ont indiqué qu'ils continueraient à lui fournir leurs produits.

J'irai en justice

Amodei a déclaré que son entreprise contesterait en justice la décision du ministère de la Défense de la déclarer comme un risque pour sa chaîne d'approvisionnement. L'homme d'affaires estime que cette décision est « juridiquement infondée ».

Le recours indique que la décision du Pentagone ne s'applique pas à la grande majorité des clients de Claude.

Selon Amodei, l'entreprise menait des discussions fructueuses avec le département de la Défense depuis plusieurs jours, mais celles-ci ont échoué suite à la fuite d'une note interne. Dans ce document, le PDG décrivait la relation d'OpenAI avec l'agence comme « davantage une démonstration de sécurité qu'une véritable protection contre les risques ».

Amodei a présenté ses excuses pour la fuite, affirmant que la société avait divulgué par inadvertance le contenu du mémorandum et n'avait donné aucune instruction à quiconque en ce sens.

« Il n’est pas dans notre intérêt d’aggraver la situation », a-t-il écrit.

Le PDG de la start-up a souligné que le document avait été rédigé quelques heures seulement après une série d'annonces concernant le retrait d'Anthropic des systèmes fédéraux. Il s'est excusé pour le ton employé, qualifiant la journée de « difficile pour l'entreprise ».

Amodei a ajouté que la note de service est une « évaluation obsolète » et ne reflète pas une « réflexion approfondie et équilibrée ». Il a déclaré que la priorité absolue de l'entreprise est de garantir que les soldats américains et les professionnels de la sécurité nationale aient accès aux outils essentiels lors des opérations de combat de grande envergure en cours.

Anthropic continuera de fournir au ministère de la Défense ses maquettes « à leur valeur nominale » aussi longtemps que nécessaire.

Dean Ball, ancien conseiller de la Maison Blanche en matière d'intelligence artificielle, a fait remarquer qu'il serait difficile pour l'entreprise de faire appel de la décision du Pentagone.

« Les tribunaux sont assez réticents à remettre en question les décisions du gouvernement concernant ce qui relève de la sécurité nationale et ce qui n'en relève pas. Pour ce faire, il faut franchir un obstacle de taille. Mais ce n'est pas impossible », a souligné l'expert.

Rappelons qu'en février, Anthropic a assoupli sa principale politique de sécurité, expliquant cela par la nécessité de maintenir sa compétitivité.